[도서리뷰] 딥러닝 입문자를 위한 책 추천, 혁펜하임 『Easy! 딥러닝』

최근 딥러닝에 대한 관심이 뜨겁습니다. 복잡해 보이는 AI 기술을 체계적으로 이해할 수 있는 책을 찾는 분들께 혁펜하임의 『Easy! 딥러닝』을 소개합니다. 이 책은 AI, 머신러닝, 딥러닝에 대한 기초부터 시작해 CNN, RNN, 트랜스포머 등 심화 주제까지 폭넓게 다룹니다.

- 특히, 저자이신 혁펜하임님은 유튜버와 강사로 활동하며 얻은 풍부한 경험을 바탕으로, 직관적인 비유와 명확한 설명으로 독자가 어려운 개념을 쉽게 이해할 수 있도록 구성되어 있습니다.

이를 통해 초보자들도 딥러닝이라는 복잡한 학문을 차근차근 따라갈 수 있으며, 실무에서도 바로 활용 가능한 지식을 쌓을 수 있습니다.

❓ 혁펜하임, 그는 누구인가

- 혁펜하임은 딥러닝 입문서 『Easy! 딥러닝』의 저자이자, AI 및 딥러닝 분야의 강사로 활동하는 전문가입니다.- 그의 닉네임 ‘혁펜하임’은 신호처리 분야의 권위자인 오펜하임 교수에게서 영감을 받아 지은 것으로 알려져 있습니다.

- 그의 닉네임 ‘혁펜하임’은 신호처리 분야의 권위자인 오펜하임 교수에게서 영감을 받아 지은 것으로 알려져 있습니다.

혁펜하임 그는, 딥러닝계의 한석원 🦾

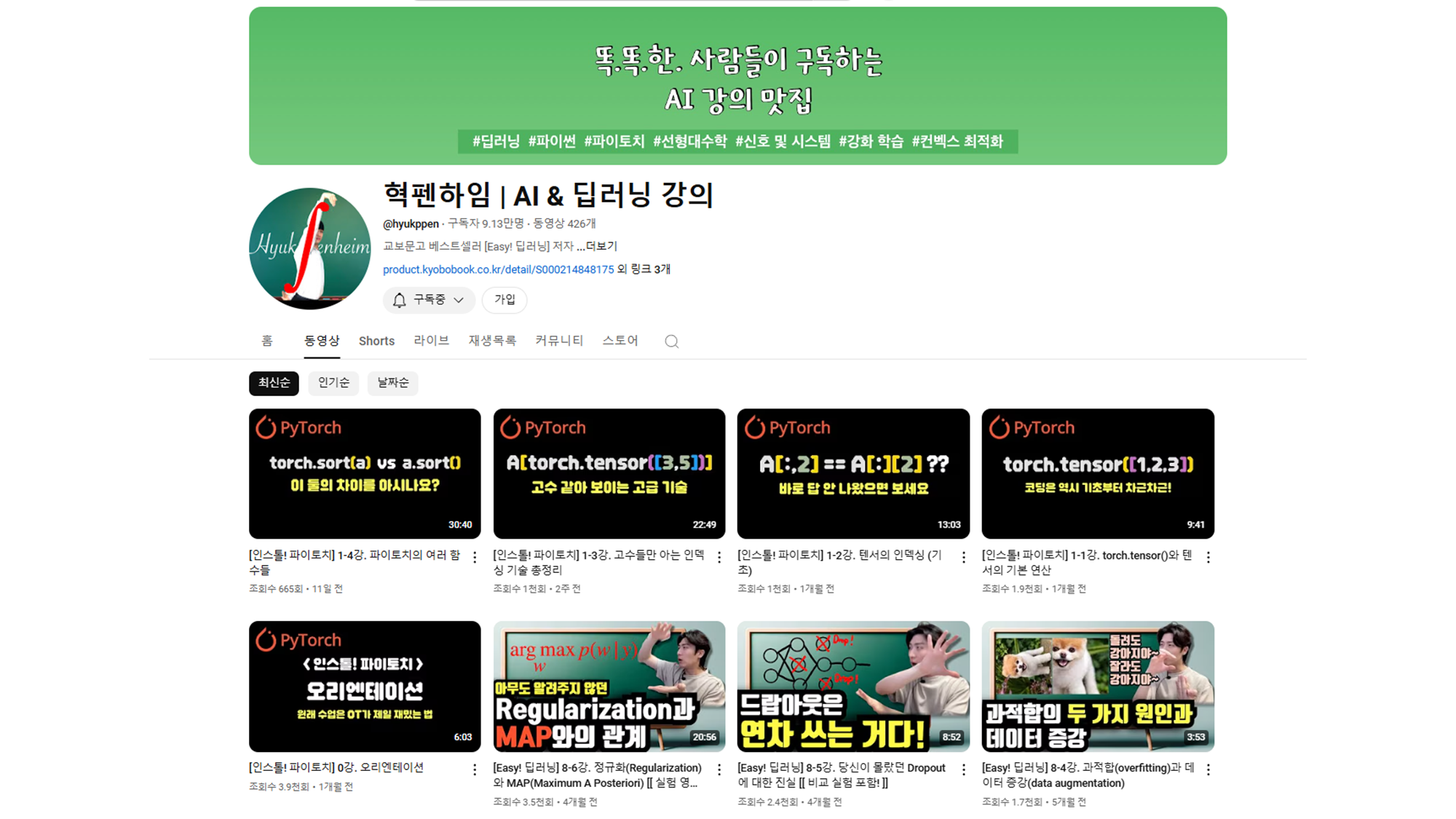

- 혁펜하임은 유튜브 채널을 통해 딥러닝과 AI 관련 강의를 제공하며, 복잡한 개념을 쉽게 설명하는 것으로 유명합니다. 그의 강의는 딥러닝 입문자들에게 큰 도움을 주고 있습니다.

- 또한, 그는 패스트캠퍼스와 협력하여 ‘혁펜하임의 AI DEEP DIVE’라는 온라인 강의를 제작하였으며, 이를 통해 딥러닝의 기초부터 심화 내용까지 체계적으로 전달하고 있습니다.

▶️ YouTube 링크: https://www.youtube.com/@hyukppen/

저 역시 재학생 시절, 혁펜하임님의 유튜브 채널을 애청하며 신호처리, 푸리에 변환과 같은 어려운 개념을 쉽게 이해할 수 있었습니다.

- 당시 그의 직관적이고 명확한 설명 덕분에 복잡한 개념을 쉽게 소화할 수 있었고, 이 경험은 제가 AI와 딥러닝에 흥미를 가지게 된 계기 중 하나였습니다.

지금도 많은 사람들이 그의 강의를 통해 딥러닝의 본질을 배우고 있습니다.

이 책의 주요 특징

『Easy! 딥러닝』의 책에 대한 특징은 아래와 같습니다:

-

초보자도 쉽게 이해할 수 있는 설명

- 딥러닝 개념을 비유적으로 풀어내며 친절하게 설명합니다.

- 어려운 수학적 개념도 직관적으로 다룰 수 있도록 부록에서 상세히 소개합니다.

- 딥러닝을 전혀 모르는 독자들도 충분히 이해할 수 있는 쉬운 예시와 설명으로 구성되어 있습니다.

-

풍부한 시각 자료와 동영상 강의 제공

- 280여 개의 삽화와 책 내용에 맞춘 동영상 강의를 통해 학습 효과를 극대화할 수 있습니다.

- 시각 자료를 통해 복잡한 개념을 더 쉽게 시각화하며, 동영상 강의는 독자의 이해를 더욱 풍부하게 만들어 줍니다.

-

이론과 실습의 완벽한 조화

- 기본 개념부터 실제 모델 설계 및 데이터 처리 방법까지 체계적으로 배우게 됩니다.

- 이론적인 설명과 함께 구체적인 실습 예제를 포함하여, 독자가 이론을 실무에 바로 적용할 수 있도록 돕습니다.

-

수학적 기초 제공

- 딥러닝을 이해하는 데 필요한 함수, 미적분, 확률과 통계 등 기초 수학을 부록으로 제공합니다.

- 특히, 기초가 부족한 독자들을 위해 각 수학 개념을 쉽게 설명하며, 딥러닝의 이론적 이해를 돕는 기반을 제공합니다.

-

실무와 연구 모두를 아우르는 구성

- 이 책은 단순히 이론적 학습에 그치지 않고, 실무에서 활용 가능한 지식과 팁을 제공합니다.

- 연구와 실무에 모두 적합한 폭넓은 주제를 다루며, 독자가 AI 프로젝트를 수행하는 데 필요한 핵심적인 도구와 방법론을 익힐 수 있습니다.

(참고) 작성 시점 기준 전자책은 아직 없지만, 곧 출시될 예정이라고 합니다! (개봉박두!)

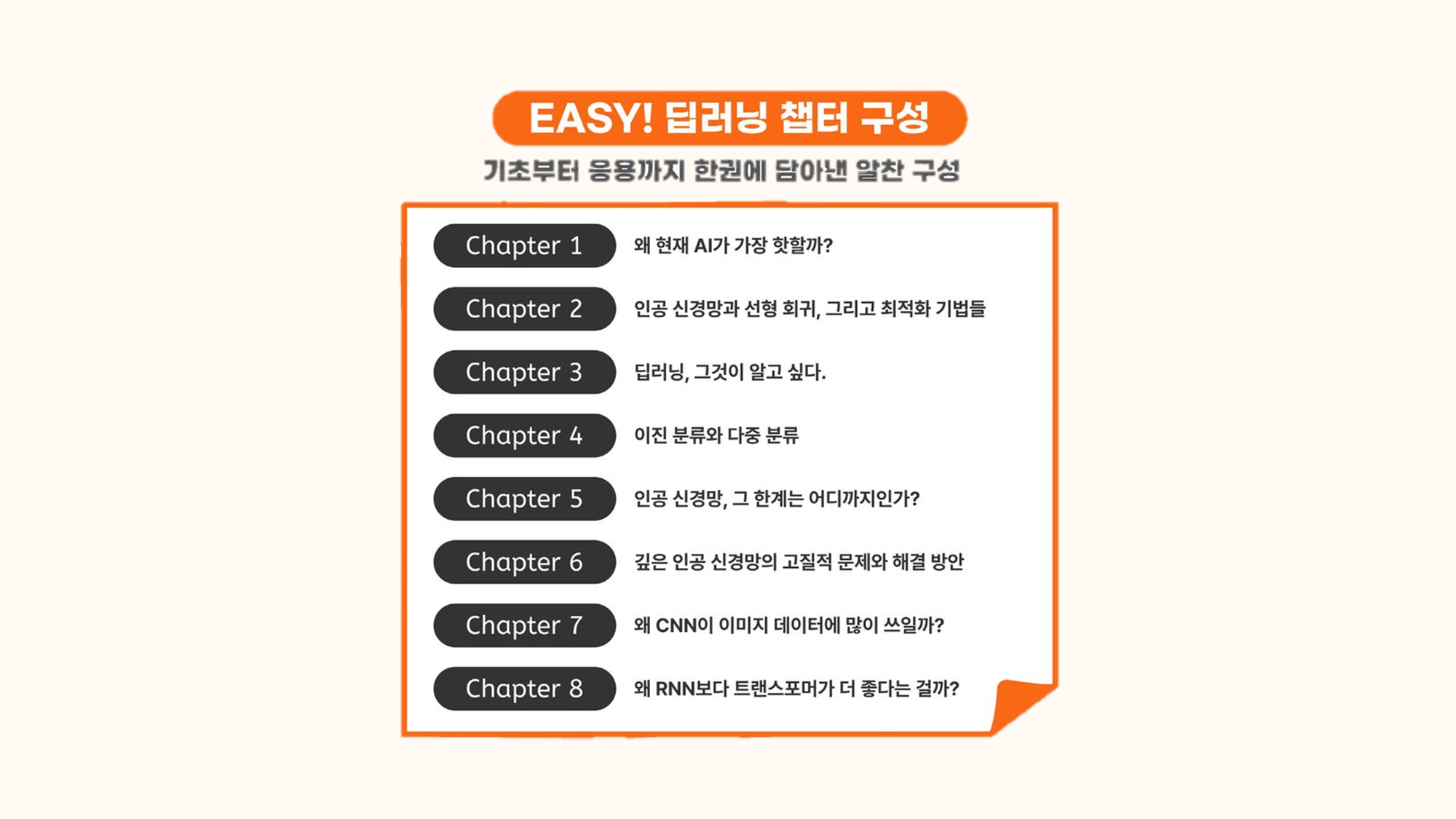

다루는 내용과 목차

이 책은 크게 8개의 챕터와 부록으로 구성되어 있으며, 딥러닝의 기본 개념부터 최신 트렌드까지 체계적으로 설명합니다.

각 장은 딥러닝의 핵심 주제를 다루며, 초보자부터 중급 독자까지 모두에게 적합한 내용으로 구성되어 있습니다.

Chapter 1 - 왜 현재 AI가 가장 핫할까?

- AI와 머신러닝, 딥러닝의 차이점을 비교하며, AI가 뜨거운 주제가 된 이유를 설명합니다. 규칙 기반 접근법과 데이터 기반 접근법의 차이를 배우며, 지도 학습, 비지도 학습, 강화 학습과 같은 딥러닝의 다양한 학습 방식을 개괄합니다.

Chapter 2 - 인공 신경망과 선형 회귀, 그리고 최적화 기법들

- 인공 신경망의 기본 구조를 이해하고, 선형 회귀부터 시작해 딥러닝에서 사용하는 다양한 최적화 알고리즘을 다룹니다. 경사 하강법, Adam과 같은 최적화 알고리즘이 포함됩니다.

Chapter 3 - 딥러닝, 그것이 알고 싶다.

- 딥러닝의 핵심 구성 요소인 다층 퍼셉트론(MLP)과 역전파(backpropagation)를 포함한 주요 기술을 설명합니다.

Chapter 4 - 이진 분류와 다중 분류

- 이진 분류와 다중 분류 문제를 해결하기 위해 사용되는 Sigmoid와 Softmax 함수, 그리고 손실 함수 설계에 대해 다룹니다.

Chapter 5 - 인공 신경망, 그 한계는 어디까지인가?

- Universal Approximation Theorem(보편 근사 정리)을 중심으로 인공 신경망의 이론적 가능성과 실제 한계에 대해 논의합니다.

Chapter 6 - 깊은 인공 신경망의 고질적 문제와 해결 방안

- 깊은 인공 신경망에서 발생하는 기울기 소실, 과적합 문제와 이를 극복하기 위한 배치 정규화(Batch Normalization), 레이어 정규화(Layer Normalization) 등의 정규화 기법을 설명합니다.

Chapter 7 - 왜 CNN이 이미지 데이터에 많이 쓰일까?

- 컨볼루션 신경망(CNN)의 구조와 원리를 중심으로, 이미지 데이터 처리에서 CNN이 왜 효과적인지 설명합니다. VGGNet과 같은 모델도 다룹니다.

Chapter 8 - 왜 RNN보다 트랜스포머가 더 좋다는 걸까?

- RNN의 한계를 극복하기 위한 Attention 메커니즘과 Transformer 구조를 중심으로 딥러닝 모델의 최신 트렌드를 배웁니다.

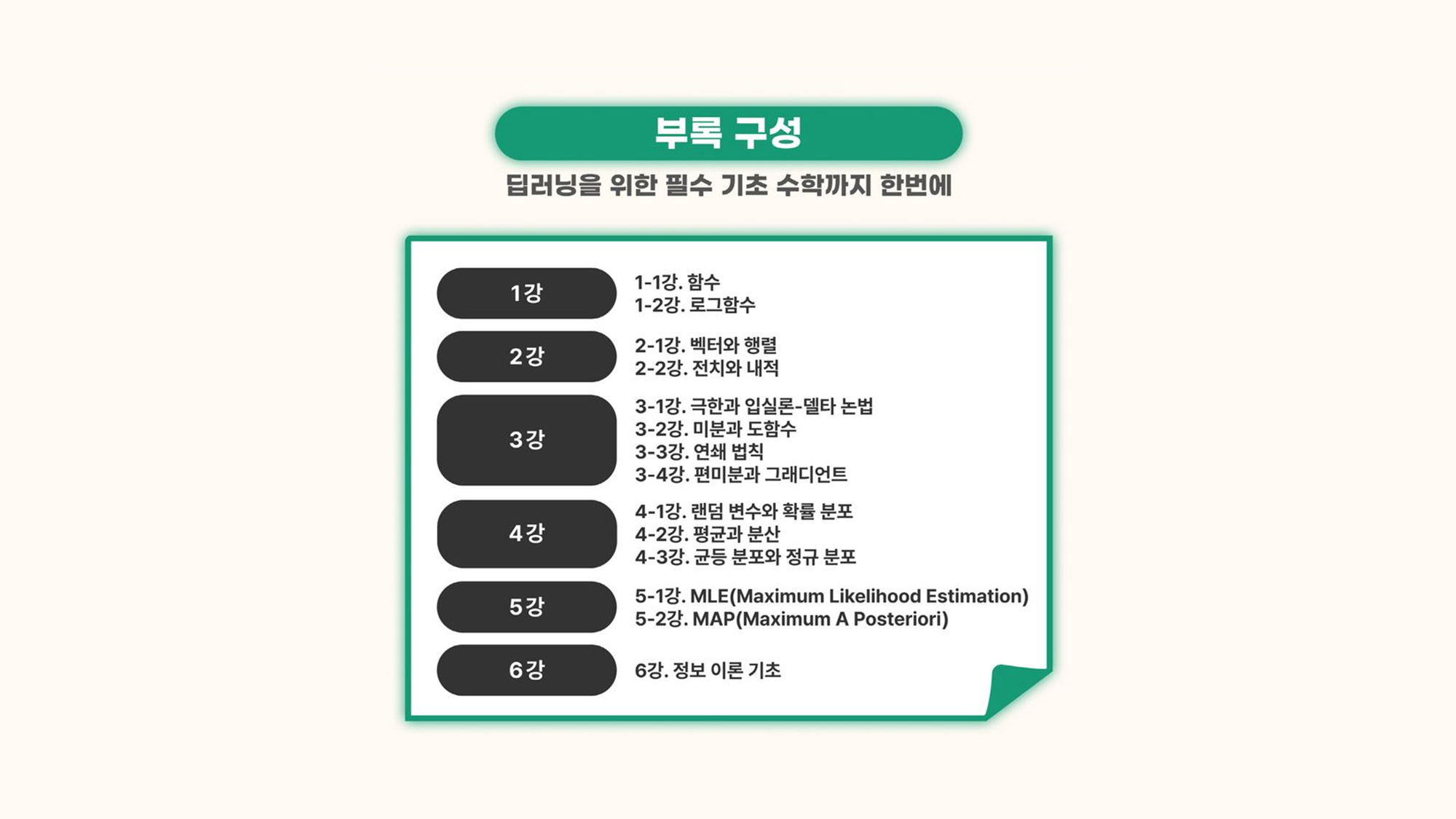

부록: 딥러닝을 위한 필수 기초 수학

- 함수, 미적분, 확률과 통계 등 딥러닝을 공부하는 데 필요한 기초 수학 개념을 정리합니다. 특히 정보 이론 기초 부분에서는 Cross-Entropy와 KL-Divergence와 같은 핵심 수학 개념을 다룹니다.

리뷰에서 다룰 내용들

이어지는 도서리뷰에서는 특히 “Chapter 6: 깊은 인공 신경망의 고질적 문제와 해결 방안”을 중심으로 다룰 예정입니다.

- 이 장에서는 딥러닝에서 발생하는 주요 문제들, 예를 들어 기울기 소실(Vanishing Gradient)과 과적합(Overfitting) 문제를 다루며 이를 극복하기 위한 현대적인 기법을 제시합니다.

- 특히, 배치 정규화(Batch Normalization)와 레이어 정규화(Layer Normalization)의 원리, 장단점, 그리고 이를 실제로 적용한 실험 결과를 심도 있게 살펴볼 계획입니다.

추가적으로 시간 여유가 있다면, 부록의 6강 정보 이론 기초 부분도 함께 리뷰할 예정입니다.

- 여기에서는 Cross-Entropy와 KL-Divergence의 수학적 배경과 이들이 딥러닝 손실 함수로 어떻게 활용되는지를 설명할 예정입니다.

- 이러한 내용은 딥러닝 이론과 실무를 연결하는 데 중요한 역할을 합니다.

💡 Info

본 게시글은 혁펜하임의 『Easy! 딥러닝』 책의 리뷰어 활동으로 작성되었습니다.

읽어주셔서 감사합니다! 🌱